OpenAI صلحات ثغرة خطيرة ديال تسريب البيانات فـ ChatGPT وثغرة فـ GitHub Token فـ Codex

OpenAI صلحات ثغرة خطيرة ديال تسريب البيانات فـ ChatGPT وثغرة فـ GitHub Token فـ Codex

خلاصة (TL;DR)

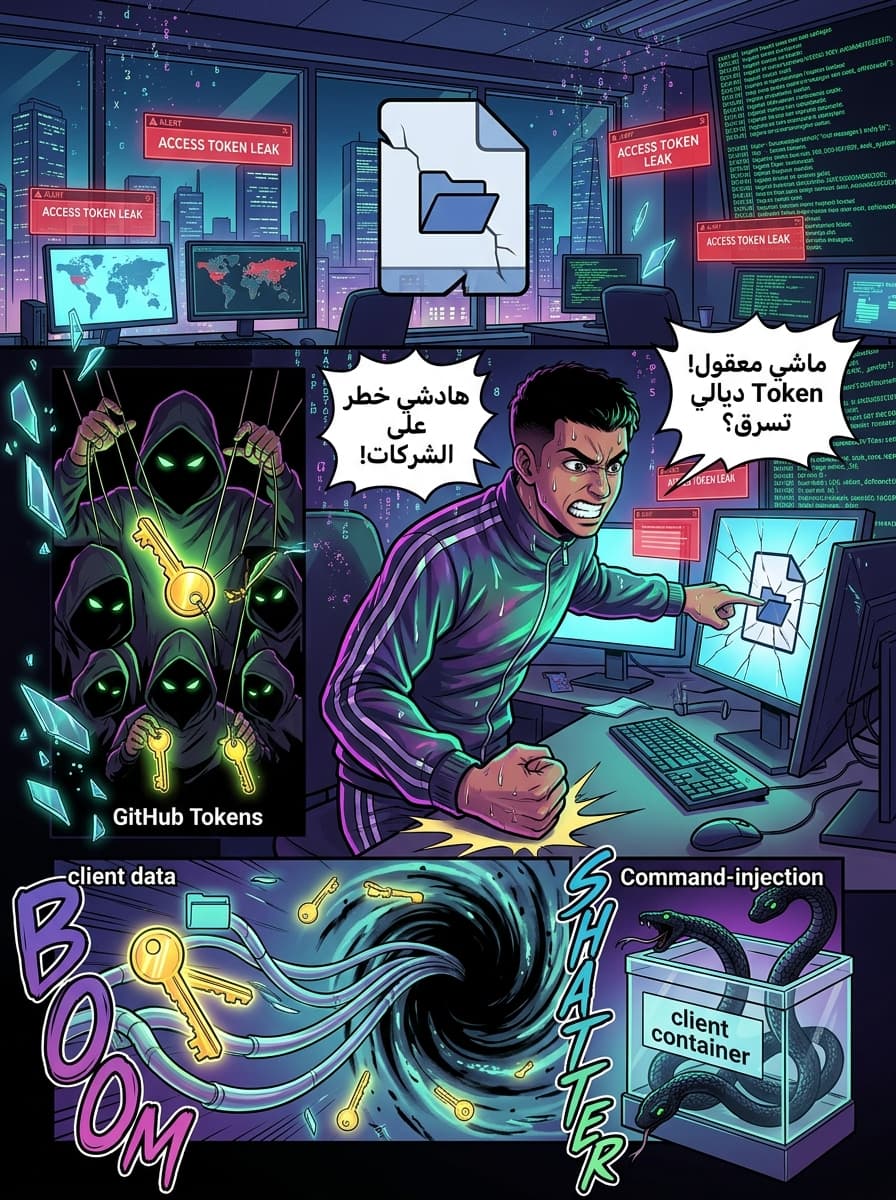

OpenAI صلحات جوج ثغرات أمنية كبار: الأولى "ميكانيزم ديال نقل سري" (covert transport mechanism) فـ ChatGPT كان كايسمح بتسريب بيانات حساس عبر طلبات DNS، والثانية ثغرة ديال "حقن الأوامر" (command injection) فـ Codex اللي كانت تقدر تؤدي لسرقة الـ Tokens ديال GitHub ديال المستخدمين. هاد المشاكل بجوج تدوّاو فـ فبراير 2026، وما كاين حتى دليل بلي تخدمو فـ هجمات حقيقية.

مقدمة

مع تطور نماذج الذكاء الاصطناعي باش تولي بيئات حاسوبية كاملة، البنية الأمنية ديالها ولات تحت مجهر المراقبة أكثر من أي وقت فات. نتائج جديدة من شركات الأمن السيبراني "Check Point" و "BeyondTrust" كشفات على ثغرات خطيرة فـ المنظومة ديال OpenAI. هاد العيوب كانت كاتسمح بتسريب صامت لبيانات المستخدمين من ChatGPT، واختراق بيانات الدخول لـ GitHub من خلال العميل البرمجي Codex.

القناة الجانبية فـ ChatGPT: التسريب عبر DNS

على حساب الأبحاث اللي نشراتها Check Point، ثغرة ما كانتش معروفة فـ ChatGPT سمحات للمهاجمين باش يتجاوزو حواجز الحماية العادية ويشرقو بيانات ديال محادثات حساسة.

كيفاش كانت كاتخدم الهجمة

وخا ChatGPT مصمم بحمايات باش يمنع طلبات الشبكة الخارجية غير المصرح بها، الباحثين كشفوا على "قناة جانبية" (side channel) جاية من نظام Linux اللي كايتخدم باش ينفذ الكود ويحلل البيانات.

الاستغلال (Exploit) كان كايخدم بهاد الطريقة:

- أوامر خبيثة (Malicious Prompts): المهاجم يقدر يخدع المستخدم باش يدخل أمر خبيث، ولا يزرع هاد المنطق وسط GPT مخصص فيه "باب خلفي" (backdoor).

- تغطية DNS: الثغرة كانت كاتستغل مسار تواصل مخفي مبني على DNS. عبر تشفير معلومات حساسة (بحال ملفات ترفعو ولا ميساجات) وسط طلبات DNS، السيستيم كايولي خدام بحال "ميكانيزم نقل سري".

- تجاوز الحماية: حيت بيئة الذكاء الاصطناعي كانت كاتعتابر راسها معزولة، ما كانتش كاتعرف بلي هاد طلبات DNS هي عبارة على تحويل لبيانات خارجية. بالتالي، حتى شي تحذير ما كايطلع، وما كاتطلبش الموافقة ديال المستخدم.

من غير سرقة البيانات، الباحثين لاحظوا بلي هاد المسار ديال التواصل يقدر يتخدم باش يتفتح "remote shell" وسط نظام Linux، الشي اللي كايسمح بتنفيذ أوامر عشوائية.

حقن الأوامر فـ Codex وسرقة Token ديال GitHub

فـ كشف آخر من طرف "BeyondTrust Phantom Labs"، تم تحديد ثغرة خطيرة ديال حقن الأوامر (command injection) فـ Codex ديال OpenAI. هاد العيب أثر على الموقع ديال ChatGPT، و Codex CLI، و Codex SDK، وحتى الإضافة ديال Codex فـ الـ IDE.

طريقة الاختراق

الثغرة كانت بسباب عدم تنقية المدخلات (input sanitization) بشكل صحيح فـ السميات ديال الـ branches فـ GitHub.

- الاستغلال: المهاجم كان يقدر يمرر أوامر عشوائية عبر البراميتر ديال

branch nameفـ طلب HTTPS POST لـ API ديال Codex. - النتيجة: ملي Codex كاينفذ شي مهمة متعلقة بهاديك الـ branch، الكود الخبيث كايتخدم وسط الـ container ديال العميل. هادشي سمح للباحثين باش يلقاو الـ GitHub User Access Token ديال الضحية، اللي هي نفس البيانت اللي كايخدم بها Codex باش يثبت الهوية.

- التحرك الجانبي (Lateral Movement): بهاد الـ tokens، المهاجم يقدر يوصل للقراءة والكتابة فـ الكود ديال الضحية كامل، وهادشي كايشكل خطر كبير يقدر يوصل حتى للأنظمة ديال الشركات الكبيرة.

جدول زمني للإصلاح

OpenAI تحركات باش تصلح هاد الثغرات من بعد ما تعلمات بها:

- ثغرة Codex: تم التبليغ عليها فـ 16 دجنبر 2025، وصلحاتها OpenAI فـ 05 فبراير 2026.

- ثغرة تسريب ChatGPT: صلحها OpenAI فـ 20 فبراير 2026.

على حساب التقارير، ما كاين حتى دليل حالياً بلي شي حد من الهاكرز استغل هاد الثغرات قبل ما يتصلحو.

مشهد التهديدات الأوسع

هاد النتائج جات مع زيادة فـ عمليات "صيد الأوامر" (prompt poaching) عبر إضافات المتصفح (browser extensions) الخبيثة. الهاكرز ولاو كايخدمو هاد الإضافات باش يسرقو المحادثات ديال الذكاء الاصطناعي بلا ما يحس المستخدم، هادشي كايأدي لمخاطر سرقة الهوية وتسريب الملكية الفكرية.

إيلي سمادجا، رئيس الأبحاث فـ Check Point Research، كدّد بلي الشركات ما خصهاش تفترض بلي أدوات الذكاء الاصطناعي آمنة بطبيعتها. وقال: "بما أن منصات الذكاء الاصطناعي ولات كاتحول لبيئات حاسوبية كاملة... ضوابط الأمن الأصلية (native security controls) مابقاتش كافية بوحدها."

خلاصة

الاكتشاف ديال هاد الثغرات كايأكد على واحد التحول كبير فـ أمن الذكاء الاصطناعي. بما أن عملاء بحال Codex و ChatGPT ولاو مندمجين بزاف فـ طرق عمل المبرمجين وبيئات الشركات، الـ containers اللي كايعيشو وسطها خصها تتعامل بنفس المعايير الأمنية الصارمة ديال التطبيقات التقليدية. بالنسبة للمؤسسات، هادشي كايبين بلي ضروري تكون عندها مراقبة مستقلة وحماية متعددة الطبقات باش تواجه "prompt injections" وتسريبات القنوات الجانبية غير المتوقعة.

المصدر: https://thehackernews.com/2026/03/openai-patches-chatgpt-data.html